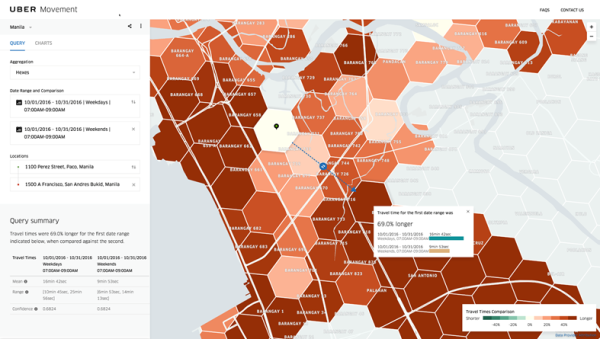

空间索引之Uber H3 – 标点符

网格系统(Grid System)对于分析海量空间数据集,将地球空间划分为可识别的网格单元(cell)至关重要。H3是由Uber开源的一个六边形分层索引网格系统…

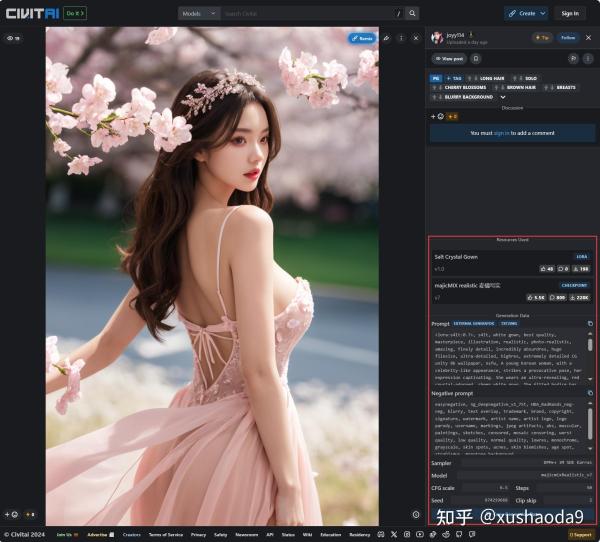

🎨 设计师必备!AI 绘图神器,让你秒变创意大师!

一、迎接AI绘图的新时代

这两年AI 可谓是改变了我们工作的方方面面,甚至也有不少设计师因为AI 而事业。

从广告、插画到影视特效,AI绘图以其高效与创意无限的…

四、Stable Diffusion 文生图/图生图-如何写提示词(prompt)

相关阅读

9700字干货!超全面的Stable Diffusion学习指南:文生图篇

这份 Stable diffusion 提示词攻略,记得收好了!

100…

AI编程零基础?Cursor从0到1的万字保姆级详解

第一章:打破编程的神话与误区

传统编程的刻板印象

编程不是高不可攀的技术

编程,曾经被神秘化,就像一个只有天才才能掌握的黑暗艺术。

但现实是,编程和做饭、学开…

RAG年终总结之12篇综述:从2022到2024看架构、策略、评测及演化

今天是2024年12月13日,星期五,北京,天气晴。

今天,我们继续来看看RAG。

参考了2022-2024三年来的12个RAG综述,共12个综述文章,设计评测…

RAG与本地知识库,向量数据库,以及知识图谱的联系与区别

“

RAG的本质是高效检索,而知识库,向量数据库和知识图谱只是组织数据的一种形式”

这两天在之前的一篇关于RAG检索增强的文章中有一个评论,问RAG和知识图谱的…

2个简单技巧把 RAG 检索准确率从 50% 提高到 95 %

在讨论了 RAG 的 chunking、embedding、评估指标、评估流程等技术后,我们进一步探讨 RAG 系统的实际应用。在实际项目中,RAG(Retri…

漫画 Transform: 手把手用数学公式推导

我学习的时候总有个执念:这个背后的底层原理是什么?

这个执念经常会让我在理解新的知识的时候,造成很大的障碍。如果我不能理解它的底层原理,我就很难去理解在它基础上…

神经网络算法 – 一文搞懂Transformer

(slot:series,id=transformer)

本文将从Transformer的本质、Transformer的原理、Transformer架构改…

神经网络算法 – 一文搞懂 Transformer(总体架构 & 三种注意力层)

(slot:series,id=transformer)

本文将从Transformer的本质、Transformer的原理、Transformer的…

神经网络算法 – 一文搞懂Embedding(嵌入)

(slot:series,id=transformer)

本文将从Embedding的本质、Embedding的原理、Embedding的应用三个方面,带…

Transformer动画讲解 – 注意力机制

(slot:series,id=transformer)

Transformer注意力机制

从端到端的角度来看,数据在Transformer中的流转可以概括…

神经网络算法 – 一文搞懂Attention(注意力)机制

(slot:series,id=transformer)

本文将从Attention的本质、Attention的原理、Attention的应用三个方面,带…

Transformer动画讲解 – Cross Attention

(slot:series,id=transformer)

Cross Attention

编码器-解码器注意力:在“编码器-解码器注意力”层中,查询来自…

Transformer动画讲解 – 单头注意力和多头注意力

(slot:series,id=transformer)

单头注意力和多头注意力

Transformer的起源:Google Brain 翻译团队通过论…

神经网络算法 – 一文搞懂Self-Attention和Multi-Head Attention

(slot:series,id=transformer)

随着Transformer模型的迅速普及,Self-Attention(自注意力机制)和Mult…

Transformer动画讲解 – 注意力计算Q、K、V

(slot:series,id=transformer)

注意力计算Q、K、V

Transformer的起源:Google Brain 翻译团队通过论文…